Отбор факторов для моделей множественной регрессии

Факторы, включаемые в модель, должны существенным образом объяснить вариацию результативной переменной.

Существует ряд способов отбора факторов, наибольшее распространение из которых имеют метод короткой регрессии и метод длинной регрессии.

При использовании метода короткой регрессии вначале в модель включают только наиболее важные факторы с экономически содержательной точки зрения.

С этим набором факторов строится модель, и для неё определяются показатели качества ESS, R2, F, ta, tbj. Затем в модель добавляется следующий фактор, и вновь строится модель. Проводится анализ, улучшилась или ухудшилась модель по совокупности критериев. При этом возможно появление парето-оптимальных альтернатив.

Метод длинной регрессии предполагает первоначальное включение в модель всех подозрительных на существенность факторов. Затем какой-либо фактор исключают из модели и анализируют изменение её качества. Если качество улучшится, фактор удаляют и наоборот. При отборе факторов следует обращать внимание на наличие интеркорреляции и мультиколлинеарности.

Сильная корреляция между двумя факторами (интеркорреляция) не позволяет выявить изолированное влияние каждого из них на результативную переменную, то есть затрудняется интерпретация параметров регрессии, и они утрачивают истинный экономический смысл. Оценки значений этих параметров становятся ненадёжными и будут иметь большие стандартные ошибки. При изменении объёма наблюдений оценки могут сильно изменяться, причём не только по величине, но и по знаку.

Мультиколлинеарность – явление, когда сильной линейной зависимостью связаны более двух переменных; она приводит к тем же негативным последствиям, о которых было сказано выше. Поэтому при отборе факторов следует избегать наличия интеркорреляции и, тем более, мультиколлинеарности.

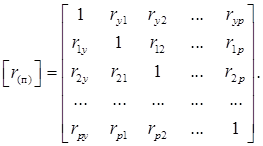

Для обнаружения интеркорреляции и мультиколлинеарности можно использовать анализ матрицы парных коэффициентов корреляции [r(п)], матрицы межфакторной корреляции [r(11)] и матрицы частных коэффициентов корреляции [r(ч)].

Для исключения одного из двух сильно коррелирующих между собой факторов можно руководствоваться таким соображением: из модели бывает целесообразно убрать не тот фактор, который слабее связан с y, а тот, который сильнее связан с другими факторами. Это приемлемо, если связь с y для обоих факторов приблизительно одинакова. При этом возможно наличие парето-оптимальных альтернатив, и тогда следует рассмотреть иные аргументы в пользу того или иного фактора.

Матрица [r(11)] получается путём вычёркивания первого столбца и первой строки из матрицы [r(п)].

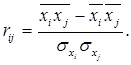

Матрица [r(11)] – квадратная и неособенная, ее элементы вычисляются по следующей формуле:

Представляется интересным исследовать определитель det [r(11)].

Если есть сильная мультиколлинеарность, то почти все элементы этой матрицы близки к единице и det → 0. Если все факторы практически независимы, то в главной диагонали будут стоять величины, близкие к единице, а прочие элементы будут близки к нулю, тогда det→1.

Таким образом, численное значение det [r(11)] позволяет установить наличие или отсутствие мультиколлинеарности. Мультиколлинеарность может иметь место вследствие того, что какой-либо фактор является линейной (или близкой к ней) комбинацией других факторов.

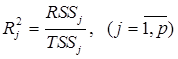

Для выявления этого обстоятельства можно построить регрессии каждой объясняющей переменной на все остальные. Далее вычисляются соответствующие коэффициенты детерминации

и рассчитывается статистическая значимость каждой такой регрессии по F –статистике: